Contents

画像検索を使ったことはありますか?

みなさんも一度は画像を検索をしたことがあると思います。

画像検索でもっとも有名なサービスが、こちらです。

出典:www.google.co.jp

検索エンジンの代名詞・グーグルが提供する「Google画像検索」です。

気になる写真やイラストを検索窓にアップすると、自動的にその画像に関する情報を表示してくれます。

この機能があるおかげで「文字にできないけど気になること」を調べることができます。たとえば

「きのうのテレビに出てたあのかわいい女優さん、誰だっけ?」

「さっき御堂筋を走ってたあのオープンカー、欲しいな!でも名前なんだっけ?」

というときに、サッとスマホを取り出して写真を撮り、画像検索にかければ、一瞬で疑問が解決します。

ここで気になるのが、一体どんな仕組みで調べているのかということです。

デジタルの文字なら、誰が書いても必ず同じ文字が書けます。文字の上手や下手、筆圧の強さは関係ありません。

しかしこれが写真やイラストに変わると、アナログな部分、たとえば描いた人の感性やクセといったものがどうしても出てしまします。

アナログテレビで地デジ放送が映らないように、デジタルとアナログは相性が悪いものです。この高い壁を、画像検索はどのように乗り越えているのでしょうか?

どうやらそこには、「ディープラーニング」という技術が大きく貢献しているようです。

今回は、知的好奇心をくすぐるディープラーニングの世界をご紹介します。

画像検索の根幹・ディープラーニングとは何者なのか

前述した「ディープラーニング」ですが、その言葉の意味を知っていますか?

ディープラーニングは、日本語では「機械学習」と訳されます。

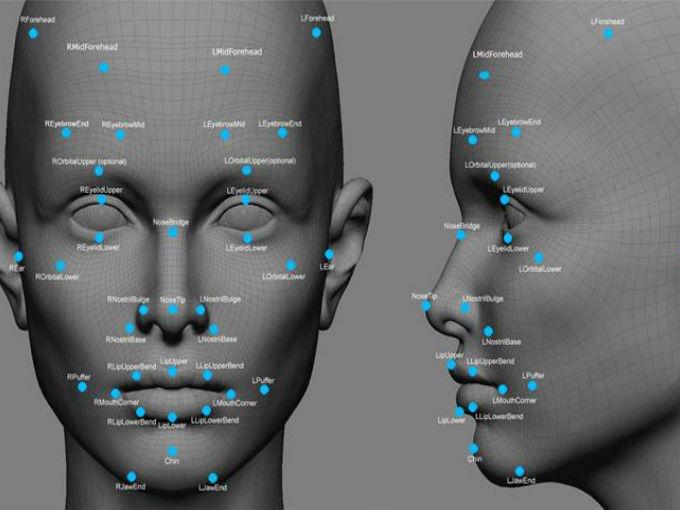

まずは、この写真を見てください。この写真には、何が映っていますか?

筆者撮影

ほとんどの方は、自動販売機と答えるはずです。ではなぜ、この写真を見て自動販売機を認識できるのでしょうか。

それは、あなたの脳の中で、このような処理が行われているからです。

- これまで生きてきた中で、たくさんの自動販売機を見てきた。

- 脳は、「四角い箱」「たくさん飲み物が並んでいる」「お金を入れられる」などの特徴を捉え、「これが自動販売機だ」と記憶した。

- この画像を見たとき、これまでに学んだ特徴を照らし合わせ、「自動販売機が映っている」と判断した。

この処理をコンピューターにマネをさせたものが、ディープラーニングの根幹を成す「ニューラルネットワーク」という機械学習ロジックです。

これを、何層にも多層化し、複雑なデータを認識できるようにしたのが、「ディープラーニング」なのです。

画像検索で、ディープラーニングの凄さを実証

では、ディープラーニングはどこまで進化しているのか、画像検索を使って実証してみましょう。

まず、PCまたはモバイル端末と、調べたい画像を用意します。

筆者撮影

今回は、この画像に映るクルマの車種名を知りたい場合に、画像検索で調べることとします。

次に、画像検索エンジンを開きます。

出典:www.google.com

今回は、もっともポピュラーなGoogle画像検索を使用します。

検索窓右端の、カメラマークをクリックし、

出典:www.google.com

「画像のアップロード」を開き、調べたい画像をドラック&ドロップします。

ちなみに、Google画像検索では、画像タイトルやプロパティといった文字情報でも同時に検索するアルゴリズムが組み込まれているので、

今回は純粋に画像情報のみで検索するために、プロパティは全部削除し、画像タイトルはこのクルマと全く関係がない “ airplane ”(飛行機)にしました。

筆者作成

するとどうでしょう

出典:www.google.co.jp

このクルマの車種名が “ Mini Cooper ” と判明するだけでなく、

なんと、発売35周年記念の限定モデルであるという情報まで分かりました!

この検索結果を導き出すために、Google画像検索の中では、以下のようなディープラーニングが行われたと推測されます。

- これまで、文字検索で多くのMini Cooperの画像を調べてきた

- 「ライトが丸い」「タイヤが小さい」などの、どの画像にも見られる共通点を記憶した

- 筆者が検索した画像の特徴を捉え、このクルマが “ Mini Cooper ” だと判断した。

このようなニューラルネットワークを、さらに「ライトの数」「ボディの色」「ホイールの形状」などの非常に細かな項目において形成し、それらを組み合わることで、この画像のクルマがMini Cooperの35周年記念限定モデルであるという結果を導き出したと考えられます。

さらに、筆者がこの画像を検索したことで、Google画像検索は4つめのディープラーニングのプロセスを行います。

- この画像に映るのは、Mini Cooperの35周年限定モデルである可能性が高まった

このように、ディープラーニングでは、コンピューターが自分で学び、自分でどんどん賢くなっていくことで、アウトプットする情報をより正確に、より具体的にしていきます。

画像検索を実現したディープラーニングの歴史

東京大学大学院情報理工学研究科の中山英樹氏によると、ディープラーニングのようなコンピューターに画像を認識させようという取り組みの歴史は、1960年代にまでさかのぼります。

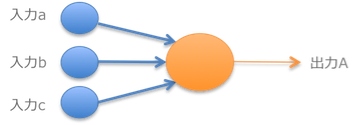

単純パーセプトロンとよばれる、複数の入力データを処理して出力する方法が発明されました。

筆者作成

しかし、この技術は単純な画像しか識別できず、2つの物の境界線があいまいな場合などは、1つの物として認識してしまうなど、問題点が多くありました。

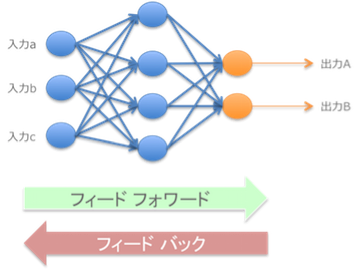

そこで、1980年代から1990年代にかけて、多層パーセプトロンとよばれる、データの修正機能がついたパーセプトロンが研究されました。

これは、出力したデータと実際のデータとのズレを計算し、学習を積み重ねることで、より正確なデータ分析を可能にしました。

筆者作成

そして、2006年ついに、ディープラーニングとよばれる複雑な認識技術が誕生しました。

これは、多層パーセプトロンをベースに、処理できるニューラルネットの数を増やしたものです。

現在では、識別性能が1年で倍になるペースで進化を続けています。世界トップクラスの識別性能をもつGoogleの場合、すでに人間並みの識別能力があるといううわさもあります。

近い将来、人間を超えた認識力や思考能力を手に入れたときには、教育、医療、物流をはじめ、現実社会のあらゆるものに革命を起こしていくかもしれません。

画像検索のディープラーニングまとめ

検索の常識を変えた、ディープラーニング。

一説には、コンピューターの知能は2018年に人間の頭脳を超え、2045年頃にはその進化の未来さえ、人間には予想できなくなるともいわれています。

今回ご紹介したディープラーニングが、この累進的な進化の一翼を担っていることは間違いありません。

機械が自ら学び、自ら育つ世界。こう聞けば、手塚治虫の「鉄腕アトム」の世界をイメージする方もいるのではないでしょうか。

手塚治虫が半世紀以上前に描いた、人間を超えた機械が人間と共存する世界は、もう間もなく訪れるのかもしれません。